Depuis la crise financière mondiale 2007-2009, les institutions comme le G20 et le Financial Stability Board ont plaidé en faveur de l’élaboration de nouvelles réglementations. Cette crise a ébranlé l’ensemble de l’écosystème financier ; elle a conduit le régulateur à repenser en profondeur la régulation financière afin de fournir au secteur financier les armes nécessaires pour faire face aux risques systémiques. Il était nécessaire du point de vue du régulateur de rendre les institutions financières plus résilientes pour faire face à la complexification et à une intensification des activités règlementaires engendrées par la crise.

Panorama des réformes et leurs objectifs

Vue d’ensemble

Une avalanche réglementaire s’est alors abattue sur les institutions financières, principalement celles qui touchaient à la réglementation comptable, prudentielle, aux activités de marché.

Dans un monde où le volume de données à traiter a explosé et où le mode de production se fait en quasi-temps réel, les établissements financiers ont dû ainsi faire face à l’émergence de ces nouvelles exigences réglementaires en termes de :

- Production des comptes avec de nouvelles règles et méthodes

- Reportings réglementaires

- Exactitude des informations à un niveau granulaire

Plusieurs textes ont vu le jour ; nous traiterons dans cet article principalement les règlementations liées aux fonctions Finance, risques, seront exclues les règlementations liées aux activités de marché et les réglementations fiscales (MiFiD, EMIR, Fatca, AEOI, FEC, 8711M…).

Les normes IFRS

Les normes sont nées de la volonté d’établir une meilleure comparabilité entre les établissements et à terme une meilleure visibilité en standardisant la présentation des données comptables échangées au niveau international. Elles sont obligatoires pour les comptes consolidés des sociétés cotées ou des sociétés faisant appel à l’épargne publique.

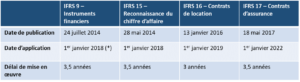

Depuis leur mise en place en 2005, la réglementation s’est renforcée par des amendements des normes existantes ou par la création de nouvelles normes pour faire face à cette crise financière, ci-dessous les dernières en date :

Ces dernières ont obligé les établissements à lancer d’importants programmes pour la mise en œuvre de ces normes. Il s’agit de mettre en conformité les états financiers selon ces normes mais également de fournir des annexes et des informations avec un niveau de détail très fin.

Les directives européennes prudentielles

Du point de vue prudentiel, en réponse à la crise financière, le Comité de Bâle[1] a présenté la réforme Bâle III avec pour objectif d’accroître la capacité de résilience des grandes banques internationales. Ces nouveaux accords prévoyaient notamment un renforcement du niveau et de la qualité des fonds propres et une gestion accrue de leur risque de liquidité. Ces règles ont été transposées en droit communautaire européen par l’intermédiaire d’une directive dite CRD 4 (Capital Requirements Directive 4).

Plus précisément, les principales avancées de la réglementation Bâle III portait sur l’amélioration de la qualité des fonds propres servant au calcul du ratio de solvabilité, et la mise en place de ratios de liquidité (LCR – Liquidity Coverage Ratio et NSFR – Net Stable Funding Ratio).

Si les travaux relatifs à Solvency II ont commencé en 2000, donc avant la crise, son objectif est de mieux adapter les fonds propres exigés des compagnies d’assurance et de réassurance aux risques que celles-ci encourent dans leur activité et répond pour partie aux mêmes objectifs que Bâle III. La date d’effet de cette directive était le 1er janvier 2016.

Ces réformes prudentielles ont toutes les deux pour objectifs de mieux proportionner les exigences de capital imposées par le régulateur aux risques auxquels banquiers et assureurs sont exposés.

Néanmoins, il existe une différence entre elles : Bâle III est une réponse à la crise de 2008, Solvabilité II, (travaux préparatoires initiés en 2000) répondait à un souci de modernisation de Solvabilité 1 devenu obsolète.

Ces deux directives demandes aux Banques et Compagnies d’assurance de fournir un reporting très détaillé avec parfois un niveau granulaire plus fin que ce qui avait été demandé avec les normes précédentes.

Les règlementations relatives aux reportings réglementaires et financiers

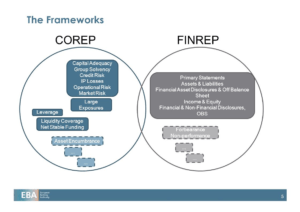

Source : EBA

Historiquement les états de reporting COREP (COmmon solvency ratio REPorting)/ FINREP (FINancial REPorting) ont été mis en place en 2007/2008 en réponse à la mise en œuvre des normes IFRS en 2005.

Lorsque les normes IFRS sont amendées ou lors de la création de nouvelles normes, l’EBA (European Bank Autority) doit définir de nouveaux états réglementaires, adaptant et améliorant ainsi les reportings COREP et FINREP existants.

Pour rappel, les états COREP sont une vue d’ensemble des fonds propres de l’établissement bancaire et des expositions aux 3 catégories de risque bâlois (risque de crédit, de marché et opérationnel).

Les états FINREP quant à eux sont des reportings comptables consolidés basés sur les normes IFRS. Ils fournissent des informations sur la situation financière, sur les performances financières des institutions bancaires. Ils fournissent au régulateur des indications sur les ratios de solvabilité, des indications sur les grands risques (large exposure), mais également des informations sur les ratios de liquidité et d’effet de levier. Ces états prennent en compte les évolutions en cours des normes IFRS (par exemple l’IFRS 9) mais avec très souvent un niveau d’informations plus détaillée avec le même enjeu de réduction des délais.

Ainsi, ces modifications impactent intensifient la difficulté de respect des délais de production, fréquence de reporting (trimestriel) et demande une adaptation du processus de de clôture avec toujours une exigence du détail plus soutenue.

La règlementation AnaCredit

Publié le 18 mai 2016, AnaCredit a été conçue pour fournir les informations complémentaires nécessaires aux missions de politique monétaire et de stabilité financière, puis des informations en matière de surveillance macro-prudentielle sur toute la zone euro. Il vise à créer une base de données statistiques européennes sur les crédits accordés par les établissements financiers des pays de la zone euro et garantit ainsi une plus grande comparabilité des données.

Du point de vue du régulateur (BCE), des informations claires et détaillées facilitent la prise de décisions monétaires et contribuent à préserver un système financier solide et transparent.

Du point de vue des Banques, la mise en œuvre de AnaCrédit, représente avant tout un coût au vu du niveau de détail demandé et de la charge de déclaration imposée (à noter que dans certains pays la déclaration d’informations granulaires est un nouveau concept).

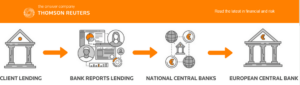

Le déploiement de AnaCredit est prévu en 3 phases :

- Phase 1 : Données à fournir concernant les prêts et dépôt – Septembre 2018 à la BdF et Mars 2019 à la BCE

- Phase 2 : Données à fournir relative aux dérivés, titre et hors bilan – 2ème semestre 2019 (date provisoire)

- Phase 3 : Prêts immobiliers pour les particuliers et aux prêts aux entreprises individuelles (date provisoire)

Pour cette première étape, seules les données concernant les prêts aux entreprises et à d’autres entités juridiques sont demandées lorsque le montant de ces prêts excède 25 000 euros. Le processus de transmission est le suivant :

Ce niveau de granularité va demander une volumétrie importante ce qui aura certains impacts importants au niveau :

- Des systèmes d’information des établissements financiers, demandant une refonte/adaptation de l’architecture des systèmes d’information finance et risques de crédit, une fiabilisation des systèmes, des rapprochements inter-périodes, des contrôles croisés avec d’autres modèles de reporting pour anticiper des impacts de volumétrie en s’assurant d’avoir une capacité à stocker des données très granulaires.

- Des données (sourcing des données) nécessitant notamment un enrichissement, une amélioration de la qualité des données existantes (optimisation de la politique de notation interne) et la mise en place d’une gouvernance dédiée des données dans le respect des exigences règlementaires de BCBS 239.

- Des métiers avec une Mise en place de nouveaux processus de production de reportings groupes et locaux.

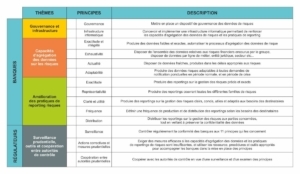

La directive BCBS239

Face à la prolifération des reportings à destination du régulateur (FINREP, COREP, FSB Reporting, Asset Quality Review,…), le comité de Bâle a souhaité approfondir les demandes faites auprès des « G-SIBs » ou banques systémiques[2]. Il a publié le 9 janvier 2013 un ensemble de principes sous la dénomination BCBS 239[3]dont l’objectif est de permettre aux banques d’améliorer leurs capacités de production et de fiabilisation des reportings réglementaires.

BCBS 239 devient ainsi le nouveau standard de réglementation bancaire, il vise à augmenter les capacités des banques en matière d’agrégation de données de risques financiers pour produire de meilleurs reportings, et il vise à améliorer la qualité de ces données risques.

Le Comité de Bâle a émis des recommandations qui reposent sur 14 principes dont 11 à destination des établissements bancaires et 3 à destination des autorités de contrôle.

Le Comité de Bâle estime que les banques doivent effectuer davantage de reporting de risques, et améliorer la qualité des informations (données) présentées.

Etant donnée, la complexité d’une telle mise en œuvre les Banques travaillent toujours sur ces sujets pour être en conformité.

Un rapport d’audit thématique de la Banque Centrale Européenne montre qu’à mai 2018, aucune des 25 institutions de crédit incluses dans l’échantillon étudié n’avait complètement mis la norme en place. Selon ce rapport, « les faiblesses proviennent avant tout d’un manque de clarté concernant la responsabilité des données. »

Le rapport conclut notamment : « La mise en œuvre complète des principes du BCBS ne sera probablement pas réalisée dans un avenir proche, car les plannings de mise en œuvre de plusieurs institutions de crédit vont jusqu’à fin 2019 et au-delà. »

« Les banques peinent notamment à appliquer les principes d’infrastructure informatique, d’exactitude et d’intégrité, et d’adaptabilité. La difficulté est liée à des problématiques technologiques. » (Source : le bigdata : BCBS 239 : tout sur la réglementation bancaire du reporting de risques)

Ainsi, les banques doivent être capables de déterminer leur exposition aux risques financiers et de gérer ces risques. Ces directives nécessitent un investissement important des banques, impliquant de manière notable une refonte des processus et de l’organisation relative à la qualité des données.

Quel constat pour une mise en œuvre ?

Les Banques, les Assureurs, mais également certaines institutions financières spécialisées ont lancé plusieurs programmes pour répondre aux exigences réglementaires.

Cela s’est traduit par une demande de données granulaire et par une multiplication exponentielle des reportings !

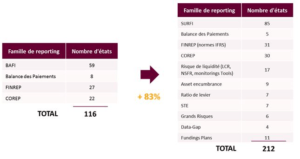

La nature et le nombre de reportings ont évolué ces 30 dernières années, de Bâle III, à Solvabilité II, mais aussi à AnaCredit et bien d’autres reportings, à titre d’exemple les établissements de crédit sont passés d’une production d’environ 30 états prudentiels à plus de 200 reportings Revue Banque : 26/10/2016 que constitue aujourd’hui les états COREP en passant par FINREP ou encore les QRT exigés par Solvency II.

Source : SIA Partners – Évolution du nombre d’états des principaux reportings existants entre 2006 et 2016

Tous ont pris conscience de l’ampleur des travaux à mener, tous ont constaté le niveau de détail des informations à fournir. La qualité des données est devenue une priorité pour le régulateur

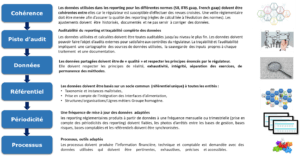

Le constat mis en avant par toutes ces exigences quelle que soit la règlementation est incontestablement la DONNEE.

Les exigences, qu’elles soient prudentielles ou financières se traduisent par la nécessité de disposer de données de qualité et d’orchestrer ce besoin autour de :

- La gouvernance des données : L’organisation, les procédures et la documentation en place dans l’entreprise permettent de gérer et piloter correctement les données tout au long de leur utilisation,

- Le dispositif de contrôle interne mis en place au niveau des processus de collecte des données permet d’assurer la qualité et les résultats des calculs réglementaires (approche standard, modèle interne)

- L’infrastructure et le système d’information : Les dispositifs de contrôle intégrés dans les solutions applicatives, les logiciels et au niveau des mécanismes techniques contribuent à la fiabilité des données lors de leur traitement, diffusion et conservation. L’architecture du SI doit contribuer à favoriser la cohérence des données et leur exactitude (mise à jour).

Vers un reporting au niveau granulaire

Ceux « qui contrôleront les données et sauront les utiliser détiendront la valeur ajoutée ». Une référence aux Gafa, les quatre géants du web : Google, Apple, Facebook et Amazon (source : La tribune du 27/11/2014 -« Les maîtres de demain seront les compagnies d’assurance et les agrégateurs de données » (Attali)). La donnée et sa fiabilité sont au cœur des métiers de la Banque et de l’Assurance.

Les Banques et les Assureurs ont besoin d’informations détaillées et disponibles rapidement sur les expositions afin de disposer de plus amples précisions pour prendre des décisions, ce qui a donné lieu mettre en place certains critères à respecter en matière règlementaire pour des données de qualité.

L’enjeu est également de répondre aux exigences du régulateur dont les demandes de reporting se sont accentuées afin d’avoir une vision claire des expositions, des risques, de complexification des échanges.

L’exploitation et la maîtrise des données devient un enjeu réglementaire

La pression des régulateurs sur les institutions financières en termes de qualité et gestion des données, a contraint ceux-ci à avoir une réflexion sur la gestion des données avec de nouvelles exigences de traçabilité et d’audit. En d’autres termes, pour être en conformité avec les nouvelles réglementations et pour produire les reportings avec au niveau granulaire exigés, les acteurs de la finance doivent revoir un certain nombre de leurs systèmes.

En effet, pour disposer d’une vue d’ensemble des données, de sa collecte à sa publication, ces acteurs vont devoir franchir le cap technologique important que bien d’entre eux avaient tenté d’éviter jusqu’à présent. Aujourd’hui, il est question de capacité de stockage, d’accès quasi-instantanée à l’information donc d’accès à la donnée, il est question de disposer d’une architecture capable de gérer des flux de données importants et fournir des données de qualité.

Dans de telles conditions une réflexion sur le big data semble être l’alternative à ce nouveau défi que doivent relever les institutions financières.

[1] Le Comité de Bâle est composé de représentants des banques centrales et autorités prudentielles de différents pays dont la France, l’Allemagne, le Canada, les États-Unis ou encore la Russie. Il est chargé de la supervision bancaire.

[2] Une banque systémique (global systemically important banks – G-SIBs) est une banque dont les activités sont tellement importantes et variées que son hypothétique faillite aurait nécessairement un effet très négatif sur la finance mondiale. Le Conseil de stabilité financière en identifie 29 dont 13 en Europe, 9 aux USA et 7 en Asie.

[3] Basel Committee on Banking Supervision’s standard numéro 239

Merci Nadji pour cet article sur la révision de la régulation financière. Il fait un beau tour d’horizon des changements réglementaires comptables post-crise.

En effet, comme tu le soulignes, trop de normes conduit à la multiplication de reporting réglementaires, c’est donc un surcroit de travail et de coûts, mais peut-être est-ce nécessaire. En revanche, il y a deux choses qui m’interpellent profondément sur ce sujet :

– cela conduit aussi à un certain désarroi stratégique avec un embouteillage des normes parfois contradictoires : CNIL et BC-FT (PPE & KYC)… et du coup ça opacifie le système et le rend peut-être source de manipulations ;

– cela donne de l’importance à la donnée au détriment de la pensée et légitime l’absence de réflexion : en faisant bien ce qui est demandé, comme tout le monde, rien ne sera reproché !

Par ailleurs, la notion de qualité n’est pas aussi évidente qu’il y parait et cela peut aussi conduire à des catastrophes. La qualité peut être une notion aux contours contextualisés comme l’est par exemple, celle de juste valeur qui sera différente selon le corpus de normes suivi. Elle peut être aussi encapsulée dans des modèles trop complexes (ou privés) pour être challengée comme ça a été le cas avec les notes attribuées à certains CDO avant la crise de 2007/2008

De mon point de vue, les dispositions prises sont cosmétiques et ne règlent en rien le problème de fond. Tu le dis toi-même, il s’agit de faire face aux risques systémiques, or, changer le système va au-delà de considérations normatives.

Changer le système pourrait être de séparer banque de détail et d’investissement, de réguler les entreprises hors sol (GAFA en particulier), de démanteler les superpuissances commerciales (aux bénéfices comparables au PIB de certains États)… Bref, des choses qui nécessitent de penser « global », mais pas à la sauce IBM, plutôt à la sauce mondiale.

Back to reality —et le brouillard qui entoure la nécessité écologique représente assez bien la force des freins structurels — ce n’est pas possible aujourd’hui (mais peut-être demain avec Elizabeth Warren ?) alors on fait de notre mieux et ce qui est proposé par les normalisateurs est probablement cette réponse-là. Alors ok pour la promouvoir, mais *en sachant que c’est une rustine*, un pis-aller. Cela permet de garder de la vigilance et de l’agilité…

En 2009 Stiglitz saluait dans la crise de 2007/2008 la prise de conscience « que le capitalisme actuel qui consiste à privatiser les profits et mutualiser les pertes n’est pas un capitalisme qui assure le bien-être des populations du monde entier ». Il avait raison et beaucoup ont compris qu’un autre modèle est nécessaire, et s’il existe des freins structurels, il est de notre responsabilité de consultant de questionner les entreprises sur ces sujets (par exemple sur une comptabilité environnementale en triple ligne d’amortissement) et de notre devoir de citoyen de ne pas les oublier. Pour pouvoir se « recréer soi-même », ne faut-il pas croire en un demain durable ?

À bientôt sur ce sujet ou sur d’autres,

Emmanuel

Bonjour Emmanuel,

Je te remercie pour ces commentaires très pertinents, il faut prendre en compte que les données que j’aborde relèvent des données financières. Je n’ai pas mené l’exercice sur les données qui ont un caractère propre aux personnes comme KYC… mais surtout sur les données financières qu’exigent les réglementations comptables et financières (IFRS, AnaCrédit, Solvency ou encore Bâle) et leurs reportings (SURFI, FINREP, COREP…).

Je vais publier la 2ème partie de mon article qui je l’espère donnera une réponse aux points que tu as soulevés.

Au plaisir de te lire, à nouveau et d’échanger nos points de vue.

Cordialement,

Nadji Thiriot-Simonel